Resumen

- Funcionarios estadounidenses han alertado a los principales bancos sobre los riesgos de ciberseguridad asociados con el modelo de IA Mythos de Anthropic, según informa Bloomberg.

- Se informa que este sistema puede identificar y explotar vulnerabilidades en sistemas operativos y navegadores.

- Anthropic ha limitado el acceso al modelo mientras evalúa los riesgos de seguridad potenciales.

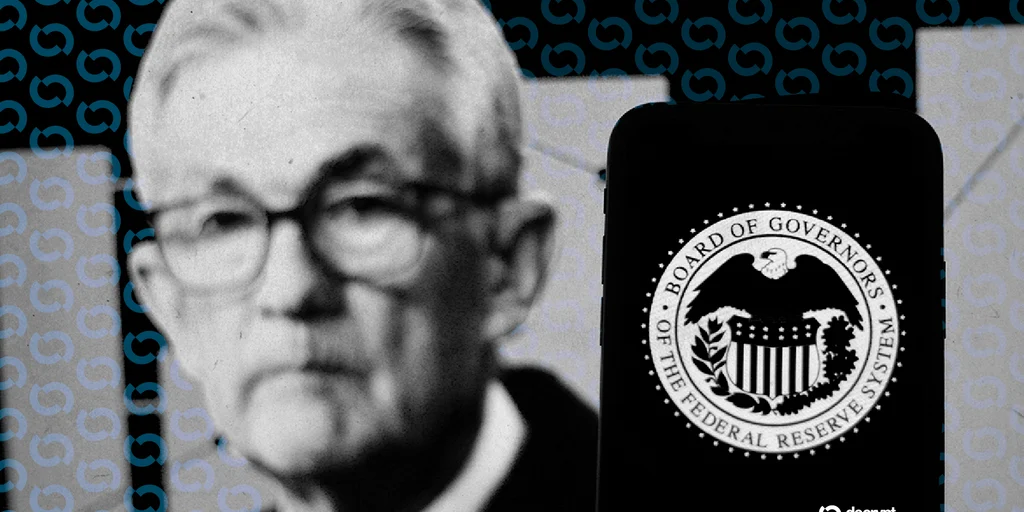

El secretario del Tesoro de EE.UU., Scott Bessent, y el presidente de la Reserva Federal, Jerome Powell, convocaron recientemente una reunión con los directores ejecutivos de importantes bancos de Wall Street para abordar los riesgos de ciberseguridad relacionados con un nuevo modelo de inteligencia artificial de Anthropic.

Según un informe de Bloomberg, en la reunión participaron ejecutivos de Citigroup, Bank of America, Wells Fargo, Morgan Stanley y Goldman Sachs. Durante la misma, se discutió el modelo de IA Mythos, que ha suscitado preocupaciones por sus avanzadas capacidades en ciberseguridad.

El objetivo de la reunión fue asegurar que los bancos comprendan los riesgos asociados con sistemas capaces de identificar y explotar vulnerabilidades en software de sistemas operativos y navegadores, además de fomentar la necesidad de reforzar las defensas ante posibles ciberataques asistidos por inteligencia artificial dirigidos a la infraestructura financiera.

Investigadores en seguridad han advertido que herramientas capaces de descubrir automáticamente vulnerabilidades podrían acelerar tanto el trabajo defensivo en ciberseguridad como el hacking malicioso si se usan de manera inapropiada.

El modelo Mythos de Anthropic fue dado a conocer por primera vez en marzo, tras la filtración de documentos preliminares que revelaron lo que la empresa describe como su modelo de IA más avanzado hasta la fecha. En las pruebas, el sistema logró identificar miles de vulnerabilidades de software desconocidas, incluidas fallos de tipo zero-day en sistemas operativos y navegadores principales.

Investigadores de Anthropic afirmaron en un informe que las capacidades de descubrimiento de vulnerabilidades de Mythos no fueron entrenadas de manera intencionada, sino que surgieron de mejoras generales en la codificación, el razonamiento y la autonomía del modelo.

“Las mismas mejoras que permiten que el modelo sea significativamente más efectivo en la corrección de vulnerabilidades también lo hacen más efectivo en su explotación”, escribió la firma.

Debido a estas capacidades, Anthropic ha restringido el acceso a un grupo reducido de organizaciones de ciberseguridad.

“Dada la fuerza de sus capacidades, estamos siendo deliberados en la forma en que lo lanzamos”, afirmó Anthropic en un comunicado. “Como es práctica habitual en la industria, estamos trabajando con un pequeño grupo de clientes de acceso anticipado para probar el modelo. Consideramos que este modelo representa un cambio significativo y el más capaz que hemos construido hasta la fecha.”

Para abordar ese riesgo, Anthropic está probando Mythos a través del Proyecto Glasswing, una colaboración con importantes empresas de tecnología y ciberseguridad que utiliza el modelo para identificar y corregir vulnerabilidades en software crítico antes de que los atacantes puedan explotarlas.

“El Proyecto Glasswing es un punto de partida. Ninguna organización puede resolver estos problemas de ciberseguridad de manera aislada”, afirmó la empresa en un comunicado. “Desarrolladores de IA avanzada, otras empresas de software, investigadores en seguridad, mantenedores de código abierto y gobiernos de todo el mundo tienen roles esenciales que desempeñar.”

Anthropic no respondió de inmediato a la solicitud de comentarios de Decrypt.

Boletín Informativo Diario

Comienza cada día con las principales noticias del momento, además de reportajes originales, un pódcast, vídeos y más.

Fuente: decrypt.co