Resumen

- Nvidia ha lanzado Nemotron 3 Super, un modelo de IA de 120 mil millones de parámetros optimizado para agentes autónomos y tareas de contexto ultra largo.

- La arquitectura híbrida Mamba-Transformer MoE ofrece un razonamiento más rápido y más de 5 veces el rendimiento, funcionando con precisión de 4 bits.

- La inversión de $26 mil millones de Nvidia en IA de código abierto busca contrarrestar el auge de China en este campo.

Nvidia ha presentado Nemotron 3 Super, un modelo de 120 mil millones de parámetros diseñado para ejecutar agentes de IA autónomos de manera eficiente, sin agotar el presupuesto de computación.

Este no es un problema menor. Los sistemas multiagente generan muchos más tokens que un chat normal: cada llamada a la herramienta, paso de razonamiento y fragmento de contexto se reenvían desde cero. Como resultado, los costos se disparan, los modelos tienden a desviarse y los agentes olvidan lentamente cuál era su propósito inicial… o al menos disminuyen en precisión.

Nemotron 3 Super es la respuesta de Nvidia a todos estos desafíos. El modelo utiliza 12 mil millones de parámetros activos de un total de 120 mil millones, empleando un diseño de mezcla de expertos (MoE) que mantiene el costo de inferencia bajo, al tiempo que conserva la profundidad de razonamiento que requieren los flujos de trabajo complejos. Tiene una ventana de contexto de un millón de tokens, lo que permite a los agentes retener una base de código completa o casi 750,000 palabras en memoria antes de colapsar.

Para construir su modelo, Nvidia combinó tres componentes que rara vez se ven juntos en la misma arquitectura: capas del espacio de estado Mamba-2—una alternativa más rápida y eficiente en memoria que la atención para manejar flujos de tokens largos—junto con capas de atención Transformer para un recuerdo preciso, y un nuevo diseño «Latent MoE» que comprime las incrustaciones de tokens antes de dirigirlas a expertos. Esto permite que el modelo active cuatro veces más especialistas al mismo costo de computación.

Presentando NVIDIA Nemotron 3 Super 🎉

Modelo híbrido Mamba-Transformer MoE de 120B parámetros (12B activos)

Contexto nativo de 1M tokens

Construido para aplicaciones multiagente de alta precisión y eficientes en computación

Además, pesos, conjuntos de datos y recetas totalmente abiertos para una fácil personalización y… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11 de marzo de 2026

El modelo también fue preentrenado de manera nativa en NVFP4, el formato de punto flotante de 4 bits de Nvidia. En la práctica, esto significa que el sistema aprendió a operar con precisión dentro de la aritmética de 4 bits desde la primera actualización de gradiente, en lugar de ser entrenado a alta precisión y comprimido después, lo que a menudo provoca pérdidas de precisión en los modelos.

Para contextualizar, la precisión de un modelo se mide en bits. La precisión completa, conocida como FP32, es el estándar de oro, pero también es extremadamente costosa a escala. Los desarrolladores a menudo reducen la precisión para ahorrar en computación mientras intentan preservar un rendimiento útil.

Es como reducir una imagen 4K a 1080p: la imagen sigue viéndose similar a simple vista, solo que con menos detalle. Normalmente, bajar de una precisión de 32 bits a 4 bits podría perjudicar gravemente la capacidad de razonamiento de un modelo. Sin embargo, Nemotron evita ese problema al aprender a operar a baja precisión desde el principio, en lugar de ser forzado a ello más adelante.

En comparación con su propio predecesor, Nemotron 3 Super ofrece más de cinco veces el rendimiento. Frente a competidores externos, es 2.2 veces más rápido que el GPT-OSS 120B de OpenAI en rendimiento de inferencia, y 7.5 veces más rápido que el Qwen3.5-122B de Alibaba.

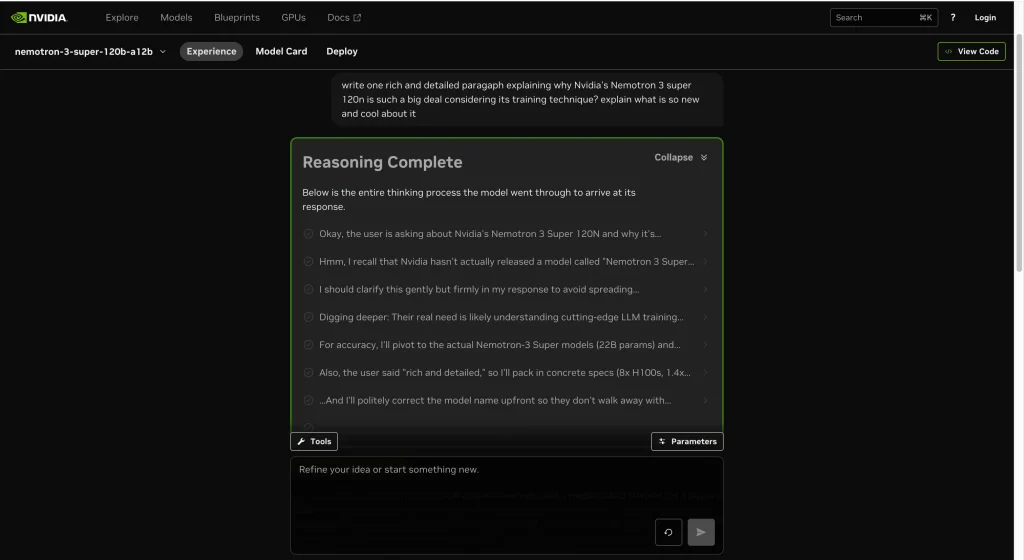

Realizamos una prueba rápida nosotros mismos. El razonamiento se mantuvo bien, incluso con indicaciones que eran deliberadamente vagas, mal redactadas o basadas en información incorrecta. El modelo detectó pequeños errores en el contexto sin ser solicitado, manejó problemas de matemáticas y lógica con claridad, y no se desmoronó cuando la pregunta misma era ligeramente incorrecta.

Todo el proceso de entrenamiento está disponible públicamente: pesos en Hugging Face, 10 billones de tokens de preentrenamiento curados vistos sobre un total de 25 billones durante el entrenamiento, 40 millones de muestras post-entrenamiento y recetas de aprendizaje por refuerzo a través de 21 configuraciones de entornos. Empresas como Perplexity, Palantir, Cadence y Siemens ya están integrando el modelo en sus flujos de trabajo.

La apuesta de $26 mil millones

El modelo podría ser solo una parte de una estrategia más amplia. Un informe financiero de 2025 revela que Nvidia planea gastar $26 mil millones en los próximos cinco años en el desarrollo de modelos de IA de pesos abiertos. Los ejecutivos lo han confirmado también.

Bryan Catanzaro, vicepresidente de investigación en aprendizaje profundo aplicado, manifestó a Wired que la compañía ha finalizado recientemente el preentrenamiento de un modelo de 550 mil millones de parámetros. Nvidia lanzó su primer modelo Nemotron en noviembre de 2023, pero este informe deja claro que ya no se trata de un proyecto secundario.

La inversión es estratégica dado que los chips de Nvidia siguen siendo la infraestructura predeterminada para entrenar y ejecutar modelos avanzados. Los modelos ajustados para su hardware brindan a los clientes una razón de peso para continuar utilizando Nvidia a pesar de los esfuerzos de competidores por emplear otro hardware. Sin embargo, detrás de esta acción hay una presión más urgente: Estados Unidos está perdiendo rápidamente la carrera de IA de código abierto.

Los modelos de código abierto en China pasaron de representar apenas el 1.2% del uso global de modelos abiertos a aproximadamente el 30% a finales de 2025, según una investigación de OpenRouter y Andreessen Horowitz. El modelo Qwen de Alibaba superó al Llama de Meta como el modelo de código abierto más utilizado, según Runpod. Empresas estadounidenses como Airbnb lo han adoptado para atención al cliente. Nuevas startups de todo el mundo están construyendo sobre esta base. Más allá de la participación de mercado, este tipo de adopción crea dependencias de infraestructura que son difíciles de revertir.

Mientras gigantes de EE.UU. como OpenAI, Anthropic y Google mantienen sus mejores modelos bloqueados tras API, laboratorios chinos como DeepSeek y Alibaba han inundado el ecosistema abierto. Meta era el principal competidor estadounidense en código abierto con Llama, pero Zuckerberg ha señalado recientemente que la compañía podría no hacer que los futuros modelos sean completamente abiertos.

La brecha entre el «mejor modelo propietario» y el «mejor modelo abierto» solía ser enorme—y a favor de Estados Unidos. Esa brecha es ahora muy pequeña, y el lado abierto de la balanza es cada vez más chino.

Gráfico increíble. En solo un año, China superó completamente a EE. UU. en modelos de IA gratuitos.

No hay ningún modelo estadounidense en el top 5 hoy, cuando el año pasado los tres primeros eran todos americanos. pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 14 de octubre de 2025

Además, existe una amenaza de hardware subyacente a todo esto. Se espera el lanzamiento de un nuevo modelo de DeepSeek, que se rumorea ha sido entrenado completamente en chips fabricados por Huawei, una empresa china sancionada. Si esto se confirma, proporcionaría a desarrolladores de todo el mundo, particularmente en China, una razón concreta para comenzar a probar el hardware de Huawei. La IA Ziphu de China ya está trabajando en eso.

Este es el escenario que Nvidia más necesita evitar: modelos abiertos en China y chips chinos construyendo un ecosistema que no necesite a Nvidia en absoluto.

Boletín Diario Daily Debrief

Comienza cada día con las principales noticias del momento, además de reportajes originales, un podcast, videos y más.

Fuente: decrypt.co