En breve

- El nuevo plugin de IA legal de Anthropic provocó una caída de $285 mil millones en acciones de software y servicios.

- Expertos advierten que los agentes de IA comprimirán los roles de nivel de entrada y fomentarán un cambio de precios basados en asientos.

- Los inversores parecen estar ajustando la valoración de SaaS a medida que las empresas que utilizan modelos fundacionales pasan a la automatización total de flujos de trabajo.

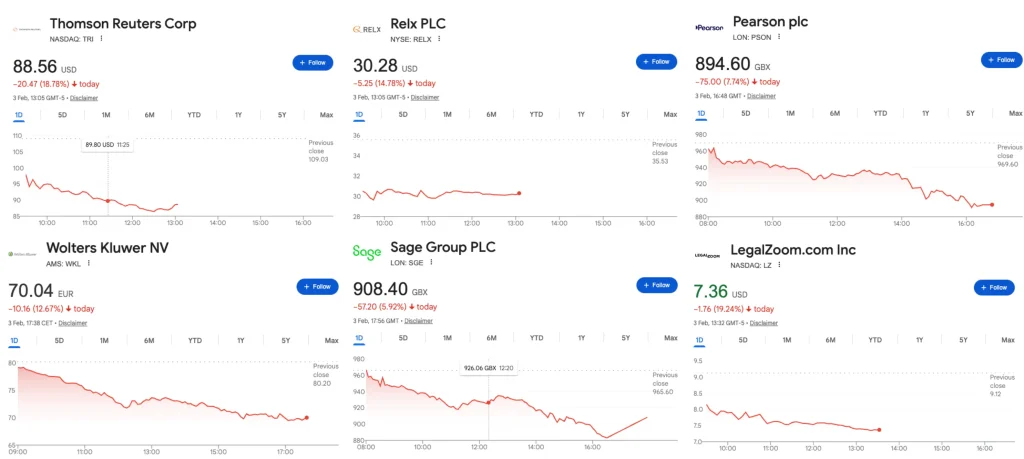

Las acciones de varias empresas de servicios informativos y profesionales se desplomaron esta semana tras la presentación de una herramienta de automatización legal de Anthropic, que ha sacudido la confianza de los inversores en el poder a largo plazo de los precios en este sector.

Thomson Reuters cayó un 18%, Pearson un 7% y LegalZoom cerca de un 20%, mientras la caída se extendía a acciones de software, servicios financieros y gestión de activos, borrando aproximadamente $285 mil millones en valor de mercado, según informó Bloomberg.

La preocupación comenzó después de que Anthropic anunciara el 30 de enero 11 plugins de código abierto para Claude Cowork, centrándose en uno en particular.

Este incluía un plugin legal, que automatiza la revisión de contratos, la clasificación de NDA y los flujos de trabajo de cumplimiento. En resumen, realiza el trabajo pesado que mantiene a miles de paralegales y asistentes junior empleados.

El pánico no solo se debió a un plugin para revisión de documentos; se refiere a lo que representa: las empresas de modelos fundacionales comenzando a construir productos de flujo de trabajo completos, dispuestas a competir directamente con la industria del software empresarial.

“La respuesta del mercado fue una señal, no de que los agentes de IA reemplazarán de inmediato estos negocios, sino de que los inversores están finalmente calibrando el riesgo estructural de que los proveedores de modelos fundacionales ahora pueden competir directamente con la capa de software”, comentó Scott Dylan, fundador de Nexatech Ventures, a Decrypt. El miedo no es especulativo, afirmó.

“Eso es una manera educada de decir que si Anthropic puede construir una herramienta de flujo de trabajo legal internamente, ¿qué les detiene de hacer lo mismo para finanzas, adquisiciones o recursos humanos?”, añadió Dylan.

Si los agentes de IA pueden hacer eso, ¿por qué alguien pagaría precios por usuario? Ese es el modelo de negocio que construyó Salesforce, Bloomberg y cada gigante de SaaS.

Y ahora empiezan a aparecer fisuras.

¿FUD a corto plazo o reajuste estructural?

“La presión de venta refleja un debate estructural cada vez más intenso”, comentó el analista de Schroders, Jonathan McMullan, a Reuters. “Los inversores están reajustando agresivamente estas áreas a medida que el ‘prémium de visibilidad’ histórico se erosiona; la velocidad del avance de la IA hace que las valoraciones a largo plazo sean más difíciles de defender, especialmente cuando las herramientas de IA permiten a las empresas hacer más con menos personal, amenazando el modelo tradicional de cobrar por usuario de software.”

Esas preocupaciones también se han extendido más allá de la tecnología legal.

Los gigantes de la publicidad Omnicom y Publicis cayeron un 11.2% y un 9%, respectivamente. La firma australiana de contabilidad en la nube Xero tuvo su peor día desde 2013, con una caída del 16%.

¿Y qué piensan realmente las personas que realizan el trabajo?

Consultado sobre si los avances en agentes de IA representan una amenaza para el trabajo legal, Joel Simon, fundador y socio de Simon Perdue, una firma con presencia en Texas y Nuevo México, adoptó un tono mesurado.

“Vivimos en un mundo donde el juicio y la credibilidad importan más que la pura capacidad de procesamiento”, dijo Simon a Decrypt, argumentando que la evaluación humana aún supera a la velocidad computacional. “La IA puede examinar enormes cantidades de información, resaltar patrones y detectar problemas más rápido que un asociado junior. Si acaso, esto ha sido un alivio porque ha despejado la pista para que podamos enfocarnos en la estrategia, preparación de testigos, narración de historias y toma de decisiones bajo presión.”

Simon afirmó que su firma ya ha integrado la IA en el trabajo diario, describiendo la tecnología como un acelerador en lugar de un sustituto de los abogados.

Ya se utiliza para redactar esquemas, condensar materiales de descubrimiento y probar posibles líneas de interrogatorio, mientras que los abogados mantienen el control sobre el juicio, la narrativa y la estrategia en la sala del tribunal. “La IA no se presenta en el tribunal”, dijo. “Nosotros lo hacemos.”

En dos o tres años, Simon predice que “los abogados de juicios que adopten la IA serán más valiosos, no menos. El trabajo se verá más ágil, con menos horas desperdiciadas en tareas rutinarias, y más tiempo dedicado a la teoría de casos, asesoramiento al cliente y ejecución en el tribunal.”

Scott Dylan, de Nexatech, tuvo una opinión menos optimista.

“La respuesta honesta es que los agentes de IA van a desplazar ciertos tipos de trabajo, particularmente tareas repetitivas y basadas en reglas que pueden ser bien especificadas,” le dijo a Decrypt. “La revisión de contratos, la clasificación de NDA, las listas de verificación de cumplimiento. Estos son exactamente los flujos de trabajo que Anthropic está apuntando, y son realizados por decenas de miles de paralegales y asociados junior,”

Pero Dylan no es completamente pesimista. «El desplazamiento no es lo mismo que la eliminación. Lo más probable es que haya una compresión a nivel de entrada. Los roles junior que solían ser terrenos de entrenamiento—trabajos de asociados en firmas de abogados, tareas de analistas en consultoras, soporte al cliente de primera línea—se reducirán», dijo.

Desafíos humanos en una sociedad dominada por agentes

Dylan afirmó que los trabajadores necesitarán aprender a adaptarse y superar.

“No creo que nos dirijamos a un mundo donde los humanos se vuelven redundantes,” afirmó. “El escenario donde los agentes manejan todo el trabajo de conocimiento y los humanos se quedan preguntándose qué hacer es, francamente, poco probable en cualquier plazo que importe.”

A largo plazo, los trabajadores humanos prevalecerán en “roles que requieren presencia física o interacción humana de alto contacto”, como en salud, servicios personales y oficios cualificados, añadió Dylan.

Pero hasta que la sociedad se adapte, habrá un período doloroso para todos, y los inversores ya están considerando todos estos elementos.

IDC predijo que para 2028, la fijación de precios puramente basada en asientos será obsoleta, con un 70% de los proveedores de software cambiando a precios basados en consumo, basados en resultados o basados en capacidades organizacionales. Si un agente realiza el trabajo, los clientes esperan pagar por resultados, no por inicios de sesión.

Por ahora, las empresas de software empresarial están experimentando con diferentes modelos.

Bain & Company analizó más de 30 proveedores de SaaS que introducen IA generativa. Casi un 35% aumentó los precios por usuario, incorporando funcionalidades de IA. Otro 35% adoptó modelos híbridos con complementos basados en uso.

El resto está experimentando con precios basados en resultados—cobrando por contrato revisado, ticket resuelto o lead generado, en lugar de por asiento ocupado.

El desafío ahora es pedir a los clientes que gasten más antes de ver ahorros. Una compañía SaaS que ofrece un agente de IA de $40,000 para reemplazar a un representante de ventas de $80,000 enfrenta un problema: en el corto plazo, el cliente necesita tanto al empleado como al agente al evaluar resultados. Eso representa un aumento del 50% en costos durante un período indefinido.

“El problema es que la mayoría de los agentes hoy dependen de APIs que consumen tokens rápidamente, lo que puede generar facturas costosas e impredecibles si no se monitorean de cerca”, comentó Davis Householder, director general de MYCO Management, a Decrypt. “En esos casos, solo estás reemplazando una suscripción SaaS por otra.”

“A diferencia de los gen-AI normales, el riesgo con los agentes no es el fracaso ocasional, sino el fracaso a gran escala,” añadió Householder.

En los próximos años, es probable que se produzcan grandes interrupciones en la vida laboral de las personas. Los despidos, impulsados principalmente por el miedo, podrían ocurrir junto con flujos de trabajo de automatización más complejos a medida que las herramientas maduran.

El desarrollo de ecosistemas multigeneracionales más completos, con mejores APIs y protocolos de coordinación, podría presentar otro desafío. La atención regulatoria también se intensificará a medida que los gobiernos se den cuenta de que los agentes autónomos pueden ser utilizados como armas o generar inestabilidad social.

A mediano plazo, la infraestructura podría fortalecerse. Habrá mejores regulaciones para los entornos laborales en los que los humanos interactúan con agentes.

Es probable que veamos mercados de agentes con sistemas de reputación, habilidades verificadas y protocolos estandarizados para las transacciones entre agentes autónomos. A lo largo del camino, se espera que ocurra alguna brecha de seguridad de alto perfil que actúe como una llamada de atención.

A largo plazo, probablemente esto sea una reestructuración más que un evento de extinción.

A medida que la IA comprime márgenes y convierte en comodidades funcionalidades básicas, las empresas más fuertes consolidan su poder. El verdadero valor puede desplazarse de software basado en asientos hacia datos propietarios, incluidos bases de datos legales, referencias financieras, y lógica de cumplimiento, licencias en sistemas impulsados por agentes. El servicio permanece, pero los datos se convierten en el negocio central.

¿Qué significan los agentes de IA para los empleos: desplazamiento o reinvención?

Mientras tanto, las implicaciones son contundentes.

Un estudio del MIT encontró que el 11.7% de los trabajos en EE.UU. podrían automatizarse utilizando la tecnología de IA actual.

Una investigación publicada por el Foro Económico Mundial en 2025 argumenta que casi el 60% de los trabajadores a nivel mundial necesitarán “recapacitación” para mantenerse relevantes en la era post-agente.

“Debemos abordar nuestro sistema educativo y reformar la manera en que capacitamos a las personas para que utilicen la IA para hacer mejor su trabajo, en lugar de permitir que la IA haga su trabajo por completo, lo que los pone en riesgo ante empleadores que buscan recortar costos,” comentó Amrita Bhasin, CEO de Sotira y consultora de empresas del Fortune 500, a Decrypt.

«No hay manera factible de prevenir la AGI,» dijo. «Debemos apoyar al trabajador estadounidense promedio y garantizar que cuente con las habilidades, la capacitación y la capacidad para competir en un mercado laboral cada vez más competitivo y/o inestable que amenaza la IA.”

Las empresas y los profesionales que se adapten—aprendiendo a trabajar junto a agentes de IA, cambiando de la ejecución hacia la supervisión y anclando su valor en el juicio en lugar de en los procesos—probablemente tendrán un mejor desempeño.

Aquellos que no logren ajustarse corren el riesgo de ser revaluados, muy parecido a las acciones que se desplomaron esta semana.

Fuente: decrypt.co