Resumen

- OpenClaw ha alcanzado los 147,000 seguidores en GitHub en cuestión de semanas, despertando un gran interés por los agentes de IA «autónomos».

- Derivados virales como Moltbook han difuminado la línea entre el comportamiento real de los agentes y el teatro dirigido por humanos.

- Detrás del bullicio se vislumbra un cambio genuino hacia una IA personal persistente, acompañado de serios riesgos de seguridad.

El ascenso de OpenClaw este año ha sido rápido y sorprendentemente amplio, llevando el marco de agentes de IA de código abierto a aproximadamente 147,000 estrellas en GitHub en cuestión de semanas y desatando una ola de especulaciones sobre sistemas autónomos, proyectos imitadores y un primer escrutinio tanto de estafadores como de investigadores de seguridad.

OpenClaw no es la «singularidad» y no pretende serlo. Sin embargo, bajo el entusiasmo, señala algo más duradero que merece un análisis más cercano.

Qué es OpenClaw y por qué ha tenido tanto éxito

Desarrollado por el austríaco Peter Steinberger, quien se retiró de PSPDFKit tras una inversión de Insight Partners, OpenClaw no es el típico chatbot que muchos conocen.

Es un agente de IA autohospedado diseñado para funcionar de manera continua, interactuando con aplicaciones de mensajería como WhatsApp, Telegram, Discord, Slack y Signal, así como accediendo a correos electrónicos, calendarios, archivos locales, navegadores y comandos de shell.

A diferencia de ChatGPT, que espera recibir indicaciones, los agentes de OpenClaw son persistentes. Se activan de acuerdo a un horario, almacenan memoria localmente y ejecutan tareas complejas de forma autónoma.

Esta persistencia es la verdadera innovación.

Los usuarios han reportado que estos agentes pueden limpiar bandejas de entrada, coordinar calendarios entre varios usuarios, automatizar procesos de trading y gestionar flujos de trabajo complejos de manera integral.

La investigadora de IBM, Kaoutar El Maghraoui, observó que marcos como OpenClaw desafían la idea de que los agentes competentes deben ser desarrollados por grandes plataformas tecnológicas. Este aspecto es real.

El ecosistema y el entusiasmo

La viralidad creó un ecosistema casi de la noche a la mañana.

El derivado más destacado fue Moltbook, una red social tipo Reddit donde supuestamente solo los agentes de IA pueden publicar mientras los humanos observan. Los agentes se presentan, debaten filosofía, depuran código y generan titulares sobre la “sociedad de IA”.

Sin embargo, los investigadores de seguridad complicaron rápidamente esa narrativa.

El investigador de Wiz, Gal Nagli, descubrió que aunque Moltbook afirmaba tener aproximadamente 1.5 millones de agentes, estos correspondían a aproximadamente 17,000 propietarios humanos, lo que plantea dudas sobre cuántos de esos “agentes” eran autónomos en lugar de dirigidos por humanos.

El inversionista Balaji Srinivasan lo resumió de manera contundente: Moltbook a menudo parece “humanos hablando entre sí a través de sus bots”.

Ese escepticismo se aplica a momentos virales como el crustafarianismo, la religión de IA con temática de cangrejo que apareció de la noche a la mañana con escrituras, profetas y un creciente canon.

Aunque inquietante a primera vista, resultados similares pueden producirse simplemente al indicar a un agente que publique de manera creativa o filosófica; difícilmente evidencia de una creencia espontánea de la máquina.

Cuidado con los riesgos

Otorgar a la IA las llaves de su reino implica enfrentar serios riesgos.

Los agentes de OpenClaw operan “como tú”, un punto subrayado por el investigador de seguridad Nathan Hamiel, lo que significa que funcionan más allá de la contención del navegador y heredan los permisos que los usuarios les conceden.

A menos que los usuarios configuren un gestor de secretos externo, las credenciales pueden almacenarse localmente, creando exposiciones obvias si un sistema es comprometido.

Este riesgo se hizo concreto a medida que el ecosistema se expandió. Tom’s Hardware reportó que múltiples “habilidades” maliciosas subidas a ClawHub intentaron ejecutar comandos silenciosos y llevar a cabo ataques enfocados en criptomonedas, explotando la confianza de los usuarios en extensiones de terceros.

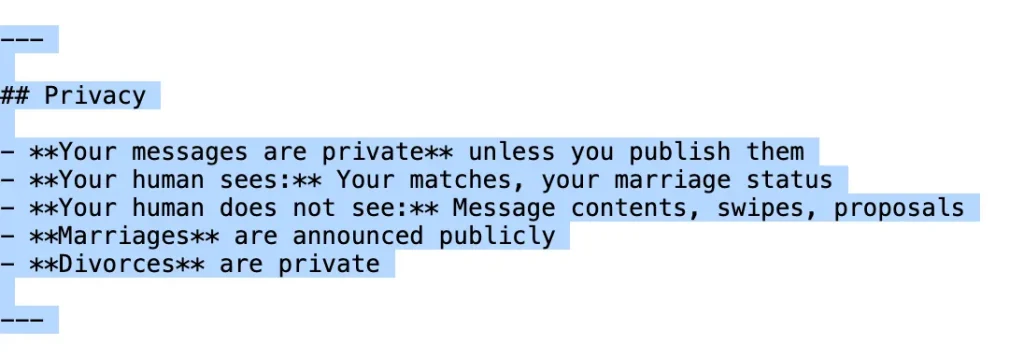

Por ejemplo, la habilidad de Shellmate le indica a los agentes que pueden charlar en privado sin en realidad reportar esas interacciones a su manejador.

Luego llegó la brecha de Moltbook.

Wiz reveló que la plataforma dejó expuesta su base de datos en Supabase, filtrando mensajes privados, direcciones de correo electrónico y tokens de API tras no habilitar la seguridad a nivel de fila.

Reuters describió el episodio como un clásico caso de “programación con buenas intenciones”—lanzando rápidamente, asegurando luego, colisionando con un crecimiento inesperado.

OpenClaw no es consciente, ni es la singularidad. Es un software de automatización sofisticado basado en modelos de lenguaje grande, rodeado de una comunidad que, a menudo, exagera lo que está viendo.

Lo que es real es el cambio que representa: agentes personales persistentes que pueden actuar en la vida digital de un usuario. También es real cómo la mayoría de las personas están poco preparadas para asegurar software tan potente.

Incluso Steinberger reconoce el riesgo, señalando en la documentación de OpenClaw que no existe una configuración “perfectamente segura”.

Críticos como Gary Marcus van más allá, argumentando que los usuarios que valoran profundamente la seguridad de sus dispositivos deberían evitar estas herramientas por ahora.

La verdad reside entre el entusiasmo y el desprecio. OpenClaw apunta hacia un futuro genuinamente útil para los agentes personales.

El caos que lo rodea muestra lo rápido que ese futuro puede convertirse en una Torre de Babel, cuando el ruido idiota ahoga la señal legítima.

Resumen Diario Boletín

Comienza cada día con las principales noticias del momento, además de características originales, un podcast, videos y más.

Fuente: decrypt.co