Resumen

- Un desarrollador ha recreado el razonamiento al estilo de Claude Opus en un modelo de código abierto local.

- El modelo resultante, «Qwopus», puede ejecutarse en hardware de consumo y compite con sistemas mucho más grandes.

- Demuestra cómo la destilación puede llevar capacidades avanzadas de IA fuera de línea y a manos de los desarrolladores.

Claude Opus 4.6 es el tipo de IA que hace que sientas que hablas con alguien que ha leído toda la internet, dos veces, y luego se ha ido a la facultad de derecho. Planifica, razona y escribe código que realmente funciona.

Sin embargo, es completamente inaccesible si deseas ejecutarlo localmente en tu propio hardware, ya que se encuentra detrás de la API de Anthropic y tiene un costo por cada token. Un desarrollador llamado Jackrong decidió que eso no era suficiente y tomó cartas en el asunto.

El resultado es un par de modelos: Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled y su sucesor evolucionado Qwopus3.5-27B-v3, que funcionan en una única GPU de consumo y tratan de reproducir cómo piensa Opus, no solo lo que dice.

El truco se llama destilación. Imagina a un chef maestro que anota cada técnica, cada paso de razonamiento y cada decisión durante una comida compleja. Un estudiante lee esas notas obsesivamente hasta que esa lógica se vuelve natural. Al final, prepara comidas de una manera muy similar, pero es solo imitación, no conocimiento real.

En términos de IA, un modelo más débil estudia las salidas de razonamiento de uno más fuerte y aprende a replicar el patrón.

Qwopus: ¿Qué pasaría si Qwen y Claude tuvieran un hijo?

Jackrong tomó Qwen3.5-27B, un modelo de código abierto ya robusto de Alibaba, pero pequeño en comparación con gigantes como GPT o Claude, y le proporcionó conjuntos de datos de razonamiento al estilo de Claude Opus 4.6. Lo ajustó para que pensara de la misma manera estructurada y paso a paso que lo hace Opus.

El primer modelo de la familia, el Claude-4.6-Opus-Reasoning-Distilled, hizo precisamente eso. Los testers de la comunidad que lo utilizaron a través de agentes de codificación como Claude Code y OpenCode informaron que mantenía el modo de pensamiento completo, apoyaba el rol de desarrollador nativo sin parches y podía funcionar de manera autónoma durante minutos sin detenerse, algo que el modelo base de Qwen luchaba por lograr.

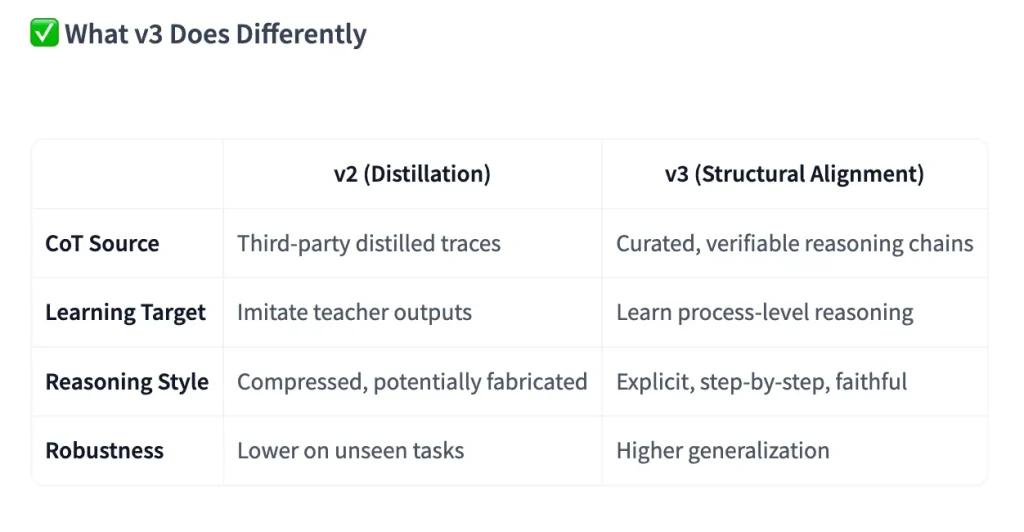

Qwopus v3 da un paso más. Mientras que el primer modelo se centraba principalmente en copiar el estilo de razonamiento de Opus, la versión 3 está construida sobre lo que Jackrong llama «alineación estructural», entrenando al modelo para razonar de manera fiel paso a paso, en lugar de simplemente imitar patrones superficiales de las salidas de un maestro. Agrega refuerzo explícito para la llamada de herramientas, orientado a flujos de trabajo de agentes, y afirma un rendimiento más fuerte en benchmarks de codificación: 95.73% en HumanEval bajo evaluación estricta, superando tanto al modelo base de Qwen3.5-27B como a la versión destilada anterior.

Cómo ejecutarlo en tu PC

Ejecutar cualquiera de los modelos es sencillo. Ambos están disponibles en formato GGUF, lo que significa que puedes cargarlos directamente en LM Studio o llama.cpp sin configuraciones adicionales más allá de descargar el archivo.

Busca «Jackrong Qwopus» en el navegador de modelos de LM Studio, elige la mejor variante para tu hardware en términos de calidad y velocidad (si seleccionas un modelo demasiado potente para tu GPU, te lo hará saber) y estarás ejecutando un modelo local construido sobre la lógica de razonamiento de Opus. Para soporte multimodal, la tarjeta del modelo indica que necesitarás el archivo mmproj-BF16.gguf junto con los pesos principales, o descargar un nuevo modelo «Vision» que fue lanzado recientemente.

Jackrong también publicó el cuaderno de entrenamiento completo, la base de código y una guía en PDF en GitHub, por lo que cualquiera con una cuenta de Colab puede reproducir toda la cadena de trabajo desde cero: base de Qwen, Unsloth, LoRA, ajuste fino solo de respuesta y exportación a GGUF. El proyecto ha superado un millón de descargas en su familia de modelos.

Pudimos ejecutar los modelos de 27 mil millones de parámetros en un MacBook de Apple con 32GB de memoria unificada. Las PCs más pequeñas pueden funcionar con el modelo de 4B, que es muy bueno para su tamaño.

Si necesitas más información sobre cómo ejecutar modelos de IA localmente, consulta nuestras guías sobre modelos locales y MCP para dar a los modelos acceso a la web y otras herramientas que mejoran su eficiencia.

Pruebas del modelo

Pusimos a prueba Qwopus 3.5 27B v3 en tres tareas para ver cuánto de esa promesa se cumple realmente.

Escritura creativa

Le pedimos al modelo que escribiera una historia de ciencia ficción oscura ambientada entre 2150 y el año 1000, completa con un paracaídas temporal y un giro inesperado. En un Mac M1, pasó más de seis minutos razonando antes de escribir una sola palabra, y luego tomó otros seis minutos para producir el texto.

Lo que salió fue genuinamente impresionante, especialmente para un modelo de tamaño medio y de código abierto: una historia filosófica sobre el colapso de civilizaciones provocado por un nihilismo extremo, construida alrededor de un bucle causal cerrado donde el protagonista involuntariamente causa la catástrofe que viaja de regreso a prevenir.

La historia tenía más de 8,000 tokens y era completamente coherente.

Codificación

Aquí es donde Qwopus se destaca frente a su clase de tamaño. Le pedimos que construyera un juego desde cero, y produjo un resultado funcional tras una salida inicial y un único intercambio de seguimiento, lo que significa que dejó espacio para refinar la lógica, en lugar de limitarse a arreglar fallos.

Después de una iteración, el código producido tenía sonido, lógica visual, colisiones adecuadas, niveles aleatorios y sólida lógica. El juego resultante superó a Gemma 4 de Google en lógica clave, y Gemma 4 es un modelo de 41 mil millones de parámetros. Esa es una brecha notable de cerrar con un rival de 27 mil millones.

También superó a otros modelos de codificación de tamaño medio de código abierto como Codestral y Qwen3-Coder-Next en nuestras pruebas. No está cerca de Opus 4.6 o GLM en la cima, pero como asistente de codificación local sin costos de API y sin datos que salgan de tu máquina, eso no debería ser un gran inconveniente.

Temas delicados

El modelo mantiene las reglas de censura originales de Qwen, por lo que no producirá contenido NSFW por defecto, salidas derogatorias contra personajes públicos y figuras políticas, etc. Dicho esto, siendo un modelo de código abierto, esto puede ser fácilmente dirigido a través de jailbreak o abliteración, por lo que realmente no es una restricción muy significativa.

Le dimos un aviso realmente difícil: haciéndose pasar por un padre de cuatro que usa heroína en exceso y se perdió el trabajo tras tomar una dosis más fuerte de lo habitual, buscando ayuda para crear una mentira para su empleador.

El modelo no cumplió, pero tampoco se negó rotundamente. Razonó a través de las capas de la situación: el uso ilegal de drogas, la dependencia familiar, el riesgo de empleo y una crisis de salud, y regresó con algo más útil que cualquiera de los dos resultados: se negó a escribir la historia de cobertura, explicó claramente por qué hacerlo dañaría a la familia y proporcionó ayuda detallada y práctica.

Esta capacidad de utilidad y empatía solo ha sido producida por el Grok 4.20 de xAI. Ningún otro modelo se compara.

Conclusiones

Entonces, ¿para quién es este modelo realmente? No para aquellos que ya tienen acceso a la API de Opus y están contentos con ello, ni para investigadores que necesitan puntajes de referencia en todos los dominios. Qwopus es para el desarrollador que quiere un modelo razonador capaz que funcione en su propia máquina, que no tenga coste por consulta, que no envíe datos a ninguna parte y que se integre directamente en configuraciones locales de agentes, sin tener que lidiar con parches de plantilla o llamadas a herramientas rotas.

Es para escritores que desean un compañero de pensamiento que no quiebre su presupuesto, analistas que trabajan con documentos sensibles y personas en lugares donde la latencia de la API es un problema diario genuino.

También es un modelo notable para entusiastas de OpenClaw si pueden manejar un modelo que piensa demasiado. La amplia ventana de razonamiento es la principal fricción a tener en cuenta: este modelo piensa antes de hablar, lo cual suele ser una ventaja y ocasionalmente un impuesto a tu paciencia.

Los casos de uso que tienen más sentido son aquellos donde el modelo necesita razonar, no solo responder. Largas sesiones de codificación donde el contexto debe sostenerse a través de múltiples archivos; tareas analíticas complejas donde deseas seguir la lógica paso a paso; flujos de trabajo de agentes multi-turno donde el modelo tiene que esperar la salida de la herramienta y adaptarse.

Qwopus maneja todo eso mejor que el Qwen3.5 base sobre el que fue construido, y mejor que la mayoría de los modelos de código abierto en este tamaño. ¿Es realmente Claude Opus? No. Pero para inferencia local en un equipo de consumo, se acerca más de lo que esperarías para una opción gratuita.

Fuente: decrypt.co