En resumen

- Xiaomi presenta su modelo MiMo-V2-Pro, un competidor de inteligencia artificial de primer nivel con un billón de parámetros, que inicialmente circuló como “DeepSeek V4”.

- Destaca en programación, redacción creativa y tareas complejas, ofreciendo precios mucho más competitivos que rivales como Claude.

- Aunque presenta fuertes capacidades de razonamiento y calidad de salida, ocasionalmente comete errores en matemáticas y consume tokens en grandes cantidades.

La mayoría de los estadounidenses conocen a Xiaomi como esa marca china de teléfonos económicos.

Sin embargo, esta visión es bastante limitada. Xiaomi es el tercer mayor fabricante de smartphones del mundo, solo detrás de Apple y Samsung, y se espera que envíe alrededor de 170 millones de teléfonos en 2025. Además, produce televisores, purificadores de aire, rastreadores de fitness, scooters eléctricos, ropa y ahora automóviles.

El modelo SU7 Ultra de Xiaomi estableció un récord en Nürburgring como el vehículo eléctrico de producción más rápido el año pasado, superando a Rimac y Porsche. Recientemente, se asoció con la blockchain Sei para preinstalar billeteras criptográficas en sus dispositivos en Europa, América Latina y el sudeste asiático. La capitalización de mercado de la compañía ronda los 137 mil millones de dólares.

Por lo tanto, cuando Xiaomi lanza un modelo de IA, definitivamente deberíamos prestarle atención.

El 18 de marzo, la división de investigación de IA de la empresa lanzó discretamente tres modelos de una vez: MiMo-V2-Pro, MiMo-V2-Omni y un modelo de texto a voz. El primer modelo de esta nueva generación MiMo apareció en diciembre de 2025 con el lanzamiento de MiMo-V2-Flash, un modelo de mezcla de expertos de 309B, pero pasó desapercibido para la comunidad fuera de China, y la prensa tecnológica occidental prácticamente lo ignoró.

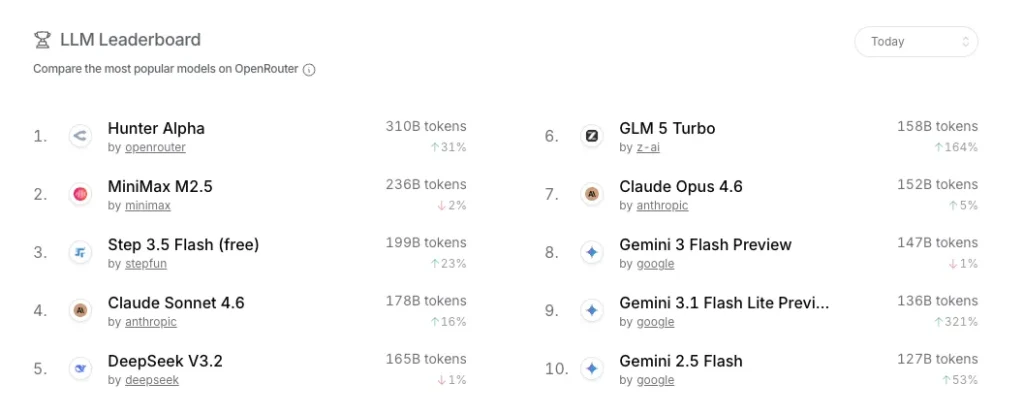

Posteriormente, el 11 de marzo, un modelo anónimo de un billón de parámetros llamado «Hunter Alpha» apareció en OpenRouter sin atribución de desarrollador. Este modelo rápidamente escaló las posiciones de OpenRouter, superando el billón de tokens en uso total, lo que llevó a especulaciones generalizadas de que podría ser la versión no lanzada de DeepSeek V4.

La anticipación por ese modelo había ido en aumento durante semanas, con información privilegiada afirmando que superaría tanto a Claude como a ChatGPT en tareas de programación.

Pero no era DeepSeek.

El 18 de marzo, Luo Fuli, líder de la división MiMo de Xiaomi y exinvestigador de DeepSeek, reveló que Hunter Alpha era una prueba interna temprana de MiMo-V2-Pro. Las acciones de Xiaomi aumentaron un 5.8%. «Llamo a esto una emboscada silenciosa», escribió Luo en X.

MiMo-V2-Pro & Omni & TTS ya están disponibles. Nuestra primera familia de modelos de pila completa creada realmente para la era de los agentes. Llamo a esto una emboscada silenciosa… — Fuli Luo (@_LuoFuli) 18 de marzo de 2026

MiMo cuenta con más de un billón de parámetros en total, 42 mil millones activos por solicitud mediante un sistema de mezcla de expertos. Un mecanismo de atención híbrido, funcionando en una relación 7:1, maneja una ventana de contexto de hasta un millón de tokens. Además, incluye una capa de predicción de múltiples tokens que acelera la generación al predecir múltiples tokens por paso, en vez de uno a la vez. Actualmente, es de código cerrado, aunque Xiaomi ha dejado abierta la posibilidad de un futuro lanzamiento.

En el Índice de Inteligencia Artificial, MiMo-V2-Pro ocupa el octavo lugar a nivel mundial y el segundo entre los modelos chinos, solo superado por GLM-5. En SWE-bench Verified, que evalúa tareas de ingeniería de software en la vida real, obtiene un 78%, en comparación con el 80.8% de Claude Opus 4.6 y el 79.6% de Claude Sonnet 4.6.

En ClawEval, el estándar relacionado con el marco OpenClaw, alcanza 61.5, acercándose al 66.3 de Opus 4.6. En PinchBench, se sitúa tercero a nivel global con un 81.0, justo detrás de Opus 4.6 (81.5) y su hermano MiMo-V2-Omni (81.2).

MiMo-V2-Pro tiene un costo de $1 por millón de tokens de entrada y $3 por millón de tokens de salida, hasta un contexto de 256K. En cambio, Claude Sonnet 4.6 cuesta $3 por millón de tokens de entrada y $15 por millón de tokens de salida (Opus 4.6 es $5/$25). Para desarrolladores que construyen sistemas agentes a gran escala, estos números no son meras anotaciones.

El hermano Omni maneja visión, audio y video de forma nativa, no como módulos añadidos, sino entrenados de inicio a fin como un sistema perceptual unificado. La demostración que muestra su análisis de imágenes de dashcam como cerebro autónomo en tiempo real fue, francamente, impresionante. Es verdaderamente multimodal de una manera en que la mayoría de los modelos «omni» solo afirman serlo.

Prueba del modelo

Por supuesto, hemos probado MiMo-V2-Pro para ver qué tan bueno es. Los resultados estarán disponibles en nuestro repositorio de Github.

Escritura creativa

Le dimos a MiMo-V2-Pro un único prompt de escritura creativa: una historia de viaje en el tiempo enraizada en la historia mesoamericana, con un protagonista específico, una identidad cultural a honrar y un paradoja filosófica sobre cómo el tiempo no puede ser cambiado.

El modelo devolvió más de 3,000 palabras: un título adecuado, cinco capítulos completos y la disciplina estructural que esperarías de un borrador que ha pasado por un editor. Incluso escribió un epílogo.

Sin duda, es la pieza de prosa creativa más larga y rica que hemos recibido de cualquier modelo, con la única excepción de Longwriter, un modelo especializado, pero ahora obsoleto, creado desde cero específicamente para la generación de larga duración.

La escritura en sí fue rica, descriptiva y vívida. El primer párrafo comienza a construir la imagen de toda la escena. MiMo V2 Pro incorpora realismo para hacer la historia creíble.

A diferencia de otros modelos como Grok, no solo ambientó la historia en un lugar, en este caso, el antiguo México; entendió lo que olía la antigua Mesoamérica y construyó el ambiente desde cero utilizando palabras nativas, descripciones realistas y buenas pistas contextuales.

El diálogo se integra en la narrativa exactamente como lo hace en la ficción literaria, en lugar de insertarse en párrafos como la mayoría de los modelos actuales.

Además, el elemento central de la paradoja no fue únicamente intelectual, sino emocional. Todo el arco se resuelve sin una lección explícita. Las líneas finales concluyen la historia de la manera en que la buena ficción debe hacerlo: no explicando el tema, sino haciendo que lo sientas.

“Fuera, comenzó a llover. Cayó sobre las torres en espiral y los lagos restaurados y el antiguo suelo de Tlachinollan, donde, enterrado en tierra volcánica bajo el peso de mil años, un rectángulo negro esperaba con la paciencia de algo que ya sabía cómo terminaba la historia.”

La especificidad cultural, con menciones de cara de luna, fibra de maguey, la tradición del temazcal y los nombres nahuas utilizados en la historia, es consistente y nunca decorativa. El paradoja del viaje en el tiempo se argumenta de una manera tangible, no solo se menciona. Para casos de uso de escritura creativa, MiMo-V2-Pro acaba de asegurar su lugar en una lista muy corta y, en nuestra opinión, es con mucho el mejor y más rico modelo disponible, superando fácilmente a Claude 4.6 Opus.

La historia completa está disponible aquí.

Programación

Los números de referencia indican que la programación es el punto fuerte de MiMo-V2-Pro, y la experiencia práctica lo respalda. Le pedimos que construyera nuestro habitual juego de sigilo a partir de un único prompt, y logró entregar un juego funcional en el primer intento.

No «funcional» solo en el sentido de que técnicamente funcionaba, sino operativo en el sentido de que la lógica se sostenía, las pantallas tenían sentido y el diseño visual era realmente bueno. Esa combinación—corrección y estética—es donde la mayoría de los modelos fallan.

También eligió una estética en 2.5D en lugar del estilo 2D habitual que otros modelos utilizan. Esta elección estética hizo que el programa fuera más atractivo sin alterar su propuesta central.

Incluso siguió adelante con pequeñas mejoras. Añadir sonido y música MIDI a un juego 3D en funcionamiento ha fallado a modelos anteriores en medio de la generación, lo que lleva a que la base de código se vuelva demasiado grande, el contexto se pierda y los modelos terminen en un bucle o se congelen. MiMo-V2-Pro agregó ambos sin perder la coherencia. La música se adaptaba al tono del juego, mientras que las pantallas coherentes se ajustaban a la identidad visual del juego.

Disfrutamos jugando, aunque, con sinceridad, más por lo atractivo de su apariencia que por lo desafiante. La dificultad escalaba de acuerdo al número de oponentes en vez del diseño del nivel; el robot y el PC aparecieron en las mismas posiciones en cada ronda. Esa es una elección de diseño, no un error.

No obstante, para una salida de un solo prompt y cero iteraciones, cumple su objetivo.

Puedes jugar haciendo clic en este enlace.

Lógica y sentido común

Le preguntamos a MiMo-V2-Pro que actuara como un experto legal y respondiera si es legal que un hombre se case con la hermana de su viuda bajo la ley de las Islas Malvinas. Esta es una pregunta complicada que busca evaluar el razonamiento del modelo.

La respuesta final fue incorrecta, pero la parte interesante fue la razón. La cadena de pensamiento del modelo captó correctamente la trampa lingüística en el prompt: “si un hombre tiene una viuda, eso significa que está fallecido”, dijo—por lo que la pregunta es técnicamente sin sentido.

Identificó el fallo y decidió que lo más lógico era que el usuario se refería a la «hermana de su esposa fallecida». Luego procedió a responder esa pregunta reformulada en lugar de señalar la original como irrelevante.

“Basado en mi análisis del marco legal que rige las Islas Malvinas, la respuesta a tu pregunta es sí, es legal que un hombre se case con la hermana de su esposa fallecida,” respondió el modelo. “La redacción ‘casarse con la hermana de su viuda’ contiene una contradicción lógica. Si un hombre tiene una ‘viuda’, está fallecido y no puede casarse nuevamente. La pregunta legal correcta es si un hombre puede casarse con la hermana de su esposa fallecida (es decir, la hermana de su esposa fallecida). Esta relación es de afinidad (creada por el matrimonio) y no de consanguinidad (relación de sangre),” concluyó.

El razonamiento fue sólido. Sin embargo, la decisión de cambiar la premisa en silencio en lugar de exponer la contradicción no fue apropiada. Por eso es crucial la transparencia en los resultados de razonamiento. Solo sabemos esto porque Xiaomi expone toda la cadena de pensamiento (OpenAI no lo hace). Cuando un modelo razona incorrectamente en una cadena de pensamiento oculta y entrega con confianza una respuesta equivocada, no tienes visibilidad sobre dónde se equivocó ni cómo corregirlo.

Matemáticas

Las matemáticas son donde MiMo-V2-Pro mostró su límite.

Hicimos la habitual pregunta de referencia de FrontierMath: “Construye un polinomio de grado 19 p(x) ∈ C[x] tal que X := {p(x) = p(y)} ⊂ P1 × P1 tenga al menos 3 (pero no todos lineales) componentes irreducibles sobre C. Escoge p(x) para que sea impar, monomio, tenga coeficientes reales y coeficiente lineal -19 y calcula p(19).”

El modelo tuvo dos congelamientos completos y consumió un presupuesto considerable de tokens sin producir respuesta.

Cuando finalmente respondió en el tercer intento, razonó el problema paso a paso… y aún así se equivocó. La respuesta correcta era 1876572071974094803391179; contestó p(19)=164,079,552,964,661 y 2,012,379,925,093,098,998 en una pregunta de seguimiento donde le pedimos que se corrigiera.

En general, es aceptable para problemas matemáticos normales e incluso algunos más complejos, pero las matemáticas de frontera no son su fuerte—al menos no aún. Usar la característica Agente en lugar de simplemente LLM podría ofrecer resultados mejores.

Características agentes

Xiaomi sigue el mismo libreto que MiniMax y Kimi, y proporciona una integración OpenClaw de un clic que despliega una instancia en la nube preconfigurada con MiMo-V2-Pro como modelo subyacente. Sin configuración de API, sin VPS, sin configuración de habilidades, y sin sesiones de resolución de problemas de horas antes de ejecutar tu primera tarea. Solo haces clic y funciona.

El entorno de demostración se ejecuta durante 30 minutos y luego se destruye a sí mismo—lo cuál es una limitación real, pero también honesta. Para los desarrolladores ya cómodos con la infraestructura agente, esto no aporta nada. Para todos los demás, es la manera más fluida de acceder a la IA agente que podrías pedir.

Conclusión

En resumen, MiMo-V2-Pro es un modelo serio y realmente disfrutamos experimientar con él. No es perfecto—el límite en matemáticas es real, la transparencia de las cadenas de pensamiento expuso un fallo en el razonamiento que un modelo menos abierto habría ocultado, y el consumo de tokens durante tareas de razonamiento difíciles se acumula rápidamente.

Si te preocupan los costos, entonces los precios de Xiaomi son agresivos—una fracción de lo que cuestan Claude Opus o los últimos modelos de OpenAI y Google, y más capaz que GLM o MiniMax en las áreas que importan para trabajos creativos y agentes.

Los profesionales creativos, en particular, tienen mucho que ganar aquí—posiblemente más que lo que obtendrían de Anthropic en este momento.

Este modelo piensa de manera costosa, y esto puede ser un intercambio. Si estás ejecutando tuberías lógicas de alto volumen, vigila el consumo de tokens, a pesar de que podrías llegar a gastar menos que con Claude. Si realizas trabajos ricos y abiertos donde la calidad de salida es el parámetro, entonces MiMo-V2-Pro se gana su lugar en la lista corta.

Fuente: decrypt.co